ملخص

يكشف مقتل طالب عراقي في غارة أميركية عام 2024، أُقر باستخدام الذكاء الاصطناعي في تحديد هدفها، كيف يمكن لتقنيات الاستهداف المدعومة بالخوارزميات أن تدفع مدنيين إلى قلب "سلسلة القتل" وسط غموض في المسؤولية وضعف في التتبع والمساءلة. وتتسع المخاوف اليوم مع استخدام هذه الأدوات على نطاق أوسع في الحروب، من العراق إلى إيران، في وقت يحذر خبراء من تراجع الحكم البشري، وتصاعد الانحياز إلى الآلة، واتساع الفجوة بين سرعة الضربات والقدرة على محاسبة من يخطئ.

غادر عبد الرحمن الراوي، وهو شاب في العشرين من عمره كان يتابع دراسته لنيل دبلوم في البناء، منزله في شارع هادئ بمدينة القائم في غرب العراق بعدما سمع دوي انفجارات في السماء.

خلال ثوانٍ، كان قد قُتل بصاروخ أميركي دمّر السيارة التي كان يقف إلى جوارها.

يستعيد شقيقه أنمار، في وصف مفجع للهجوم، ما جرى قائلاً في تحقيق مشترك أجرته "اندبندنت" بالاشتراك مع منظمة "إيروارز" Airwars: "احتجنا يومين كاملين لجمع أشلاء أخي.

قُتل عبد الرحمن في واحدة من 85 ضربة منسقة نفذتها الولايات المتحدة في تلك الليلة من فبراير (شباط) 2024 ضد فصائل عراقية موالية للحكومة وميليشيات مدعومة من إيران في العراق وسوريا.

واعتُبرت العملية ناجحة، بل إن مسؤولاً أميركياً كبيراً تفاخر لاحقاً باستخدام تكنولوجيا ذكاء اصطناعي متطورة للغاية لتحقيق دقة الاستهداف.

لكن هذا التفاخر سرعان ما تهاوى، بعدما تبين أن ما يصل إلى ثلاثة مدنيين أبرياء ربما سقطوا في الهجوم.

ولم يكن مقتل عبد الرحمن موضع خلاف، بل حتى أن مسؤولين أميركيين وجهوا رسالة تعزية إلى عائلته أقروا فيها بأنه قُتل عن طريق الخطأ.

غير أن التسلسل الدقيق لما حدث، والدور الذي أداه الذكاء الاصطناعي في العمليات الهجومية العسكرية، بما في ذلك العمليات الأميركية والإسرائيلية الجارية في إيران، أصبحا في صلب التدقيق والجدل.

ويرجح تحقيق "اندبندنت" و"إيروارز" أن عبد الرحمن هو أول ضحية مدنية معروفة يُعترف بسقوطها في غارة جوية استُخدم فيها الذكاء الاصطناعي للمساعدة في تحديد الهدف.

لكن حين سُئلت القيادة المركزية الأميركية "سنتكوم" عن ذلك، قالت إنها لا تملك وسيلة لمعرفة ما إذا كانت الغارة التي قتلت عبد الرحمن من بين الضربات التي استُخدم فيها الذكاء الاصطناعي للمساعدة في تحديد الأهداف. ورأى أحد الخبراء أن هذا الكلام وحده كافٍ لإثارة أقصى درجات القلق.

وقالت "سنتكوم": "لا نملك وسيلة لمعرفة ما إذا كانت هذه الضربة واحدة من الضربات الـ85 المذكورة... ولم يُعثر على أي أخطاء في عملية التدقيق التي أجراها المحللون أو في عملية تقدير الأضرار الجانبية، كذلك التزمت قوة المهام المشتركة في عملية "العزم الصلب" بجميع قواعد الاشتباك".

لكن خبراء حذروا بشدة، في مقابلات مع "اندبندنت"، من دلالات هذه التصريحات.

وتقول جيسيكا دورسي، أستاذة القانون الدولي المتخصصة في حروب الذكاء الاصطناعي بجامعة أوتريخت: "إذا كانوا يقولون إنهم لا يملكون وسيلة لمعرفة ما إذا كانت هذه الضربة واحدة من الضربات الـ85 التي استُخدم فيها الذكاء الاصطناعي، فهذا يعني ببساطة أنهم لا يحتفظون بسجلات لتقييمات الاستهداف".

وتضيف: "هم غير قادرين على تتبع مصدر المعلومات والاستخبارات التي أفضت إلى اختيار هذا الهدف تحديداً لضربه".

كذلك تحذر الدكتورة إلكا شوارتز، من جامعة كوين ماري، من أن اتساع نطاق هذه الأنظمة المدعومة بالذكاء الاصطناعي وسرعتها "يجعلان الحكم البشري يتراجع إلى حد ما".

كيف أودى هجوم بمساعدة الذكاء الاصطناعي بحياة مدني

جاء الهجوم على القائم، الواقعة قرب الحدود السورية وعلى بعد نحو 400 كيلومتر شمال غربي بغداد، رداً على هجوم استهدف قاعدة أميركية في شمال الأردن في أواخر يناير (كانون الثاني) 2024، وأسفر عن مقتل ثلاثة جنود.

وقد حولت الضربات الأميركية عدداً من مباني القائم إلى أنقاض. وأصيب ما يصل إلى 15 شخصاً بجروح، كذلك يُعتقد أن ما بين ثلاثة وخمسة من العاملين في المجال الطبي ضمن قوات الحشد الشعبي قُتلوا أيضاً. ويجدر التذكير بأن العاملين في المجال الطبي يتمتعون بحماية بموجب القانون الإنساني الدولي.

وكان لمقتل عبد الرحمن وقع مدمر على أسرته. يقول أنمار، وهو ممرض في مستشفى محلي: "لا يزال والدي غارقاً في اكتئاب شديد. أما والدتي، فأصيبت بنوبة قلبية وتعاني من ارتفاع ضغط الدم منذ ذلك الحين. وكلما تذكرت طفلها الصغير تنهار".

وقالت "سنتكوم" إن الأهداف المقصودة في ضربات الثاني والثالث من فبراير من ذلك العام، التي أدانتها الحكومة العراقية، شملت مراكز قيادة وتحكم، ومنصات إطلاق صواريخ، ومنشآت مرتبطة بسلاسل الإمداد.

وفي وقت لاحق من ذلك الشهر، قالت شويلر مور، كبيرة مسؤولي التكنولوجيا في "سنتكوم" آنذاك، في مقابلة مع "بلومبيرغ"، إن أهداف تلك الليلة جرى تحديدها بمساعدة خوارزميات تعلم آلي تُعرف باسم "مشروع مافن" Project Maven.

ويُعتقد أن هذا كان أول إعلان علني من نوعه يصدر عن الجيش الأميركي بشأن استخدام الذكاء الاصطناعي في ضربات بعينها.

اقرأ المزيد

يحتوي هذا القسم على المقلات ذات صلة, الموضوعة في (Related Nodes field)

وكان البنتاغون قد طور مشروع "مافن" في الأصل، قبل أن تتبناه لاحقاً الوكالة الوطنية للاستخبارات الجغرافية المكانية. ويستخدم المشروع خوارزميات للرؤية الحاسوبية لتحديد مواقع الأهداف والتعرف إليها عبر صور الأقمار الاصطناعية، إلى جانب استخدام الرادار لرصد الحركة وتعقب الأهداف.

وقالت مور: "كنا نستخدم الرؤية الحاسوبية لتحديد الأماكن التي قد توجد فيها تهديدات. ومن المؤكد أننا حظينا بفرص أكبر للاستهداف خلال الستين إلى التسعين يوماً الماضية".

وفي مقابلة لاحقة مع "بلومبيرغ"، قالت: "أصبح مافن بالغ الأهمية بالنسبة إلى عملنا".

وبعد أشهر، وفي تقرير عن الأضرار المدنية صدر أواخر عام 2024، أقر الجيش الأميركي للمرة الأولى بأنه "من المرجح بدرجة كبيرة" أن تكون الغارة قد تسببت في مقتل مدنيين اثنين.

وفي يوليو (تموز) من العام التالي، أكد تقرير لوزارة الدفاع الأميركية مقتل رجل بالغ في الغارة، مضيفاً أنه جرى التواصل مع أسرته لتقديم التعازي.

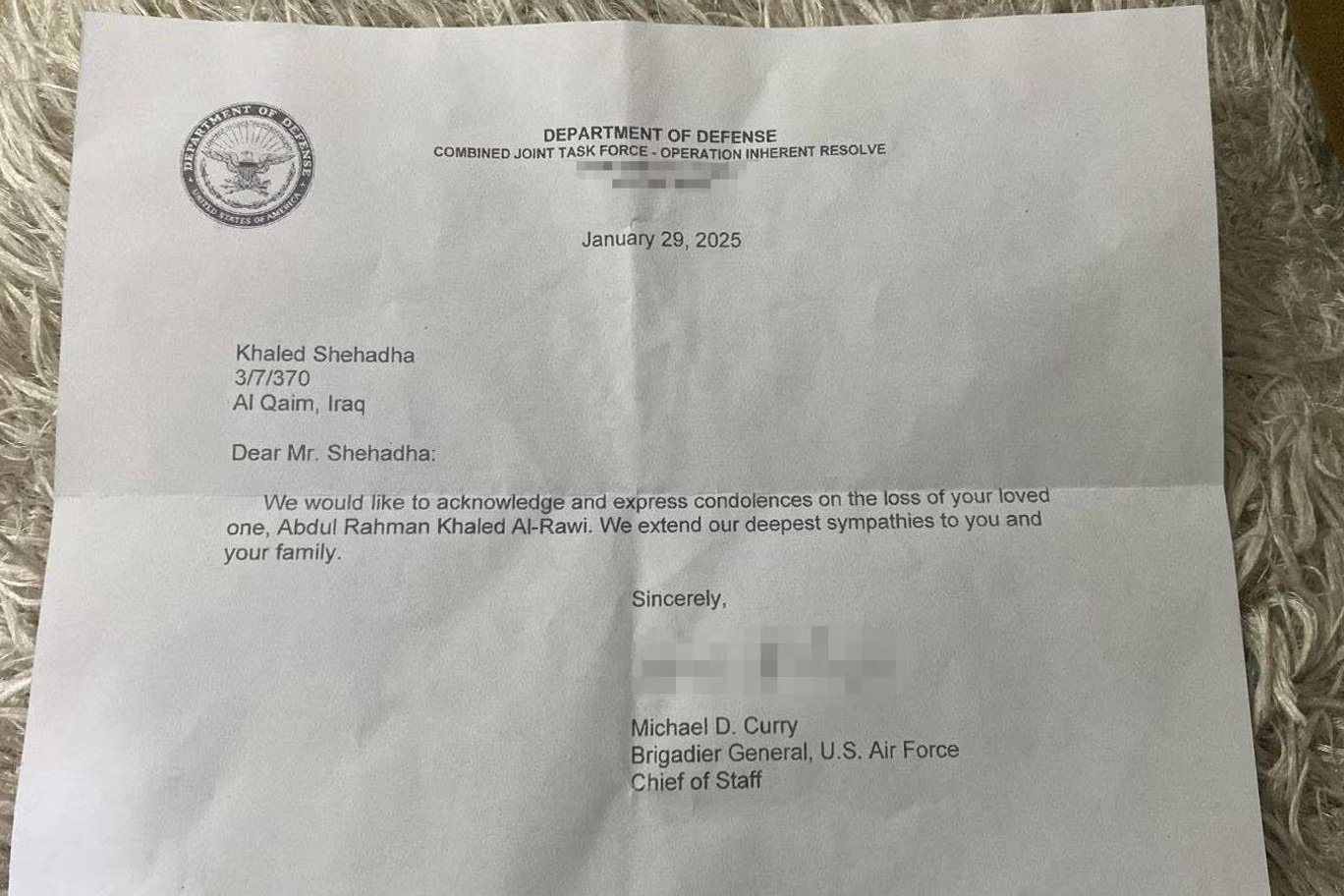

وجاء في رسالة التعزية، التي وقعها جنرال في سلاح الجو الأميركي، وحصلت عليها "إيروارز" بعد تعقبها عائلة عبد الرحمن عبر الإنترنت: "نود أن نعرب عن تعازينا في فقدانكم عزيزكم عبد الرحمن خالد الراوي. ونتقدّم بأصدق مشاعر المواساة إليكم وإلى عائلتكم".

ويقول أنمار إن العائلة استقبلت الرسالة، التي لم تتجاوز سطرين، بغضب، لأن الجيش الأميركي امتنع فيها عن الإقرار صراحة بمسؤوليته عن القتل. ويضيف: "لم نحصل منهم على شيء... سوى البؤس".

وهذا بدوره يفتح الباب أمام مزيد من الأسئلة بشأن مشروع "مافن".

مشروع "مافن" ومستقبل الحرب المقلق

أُطلق مشروع "مافن"، وهو المشروع الأميركي الأبرز لإدخال التعلم الآلي إلى المؤسسة العسكرية، عام 2017، ويقع في قلب المخاوف من تغليب الذكاء الاصطناعي على القرار البشري.

وباتت الجيوش المتقدمة تسعى على نحو متزايد إلى إدماج الذكاء الاصطناعي في مختلف حلقات ما يُعرف بـ"سلسلة القتل"، سعياً إلى تسريع عملية الاستهداف وكسب أفضلية على الخصوم.

ومن بين أسباب القلق أن "مافن"، على وجه الخصوص، يواجه صعوبة في التكيف مع تضاريس مختلفة، وقد تهبط دقته في بعض الظروف إلى أقل من 30 في المئة، بحسب ما قاله مسؤولون أميركيون لـ "بلومبيرغ".

ويكمن خطر آخر في ما تصفه البروفيسورة دورسي بـ"تحيز الأتمتة"، أي أن يبدأ البشر، مع مرور الوقت، في الوثوق بمخرجات الحاسوب من دون إخضاع الهدف لتقييم نقدي مستقل.

فكلما ازداد اعتماد الجيوش على الاستهداف المدعوم بالذكاء الاصطناعي، ازدادت درجة نقل الأفراد مسؤولياتهم إلى الآلات. وتقول دورسي: "نحن نفقد مهاراتنا تدريجاً. ويصبح القادة أقل كفاءة في تحديد ما ينبغي أن يتحملوا مسؤوليته في ساحة المعركة".

وتضيف الدكتورة شوارتز، المتخصصة في تكنولوجيا الحرب، أن الاستهداف المدعوم بالذكاء الاصطناعي "يقوّض الفهم التقليدي لما كان يعنيه القتال والقتل في الحرب حتى الآن".

وتقول أيضاً: "يميل البشر إلى عدم التشكيك في القرارات التي تنتجها الأنظمة الحاسوبية".

وفي الولايات المتحدة، كان استخدام الذكاء الاصطناعي من قبل الجيش محور نزاع بارز بين شركة الذكاء الاصطناعي "أنثروبيك" ووزارة الدفاع الأميركية.

وفي 26 فبراير، رفضت "أنثروبيك" مطالب وزارة الدفاع بالسماح باستخدام أدواتها، مثل "كلود"، في عمليات مراقبة داخلية جماعية وفي أسلحة ذاتية التشغيل بالكامل.

وفي 6 مارس (آذار)، استقالت كيتلين كالينوفسكي، التي كانت تقود مبادرات الروبوتات في "أوبن أي آي"، بعد إبرام الشركة اتفاقاً مع وزارة الدفاع يسمح باستخدام تقنياتها في بيئات ذات تصنيف سري، وهو ما حذرت من أنه قد يؤدي إلى "مراقبة الأميركيين من دون إشراف قضائي، وتشغيل أنظمة قاتلة ذاتية من دون إذن بشري."

وفي هذا الأسبوع، رفعت "أنثروبيك" دعوى قضائية ضد إدارة ترمب، ساعية إلى إلغاء قرار البنتاغون تصنيفها "خطراً على سلسلة التوريد."

ومنذ 28 فبراير، أفادت تقارير باستخدام الاستهداف المدعوم بالذكاء الاصطناعي على نطاق واسع في هجمات طاولت مناطق مختلفة من إيران، قالت وكالة أنباء نشطاء حقوق الإنسان (HRANA) إنها أسفرت عن مقتل أكثر من 1200 مدني، بينهم 194 طفلاً.

وذكرت "واشنطن بوست" أن نظام Maven Smart System (MSS) التابع لشركة "بالانتير" جرى ربطه بنظام الذكاء الاصطناعي "كلود" التابع لـ"أنثروبيك" لتنفيذ هذه الضربات. ويُعد MSS نظاماً أشمل لدعم القرار، إذ يدمج أنظمة استهداف مختلفة مدعومة بالذكاء الاصطناعي، مثل مشروع "مافن" التابع للوكالة الوطنية للاستخبارات الجغرافية المكانية. وقد استخدمت الولايات المتحدة هذين النظامين في مهام قتالية فعلية.

ومن الجوانب الحاسمة في فهم مقتل عبد الرحمن معرفة مدى إسهام الذكاء الاصطناعي في اتخاذ قرار تنفيذ الضربة، وحجم الثقة التي منحها لمن نفذها في أن الهدف مشروع.

لكن بالنسبة إلى أنمار، الذي يقول إن الأسرة لم تتلقَّ أي تعويض من الجيش الأميركي، فلن يعيد أي فهم متأخر أو مراجعة لاحقة شقيقه الأصغر إلى الحياة.

© The Independent